Bộ mặt vạn năng có thể "bẻ khóa" nhiều hệ thống nhận diện

Nhóm các nhà nghiên cứu tại Israel cho biết bằng cách sử dụng AI, họ có thể đánh lừa hầu hết công nghệ nhận diện khuôn mặt sinh trắc học.

Công nghệ nhận diện khuôn mặt ngày càng được sử dụng rộng rãi trên thiết bị cá nhân lẫn trong công nghiệp. Tuy nhiên, nhóm nhà khoa học máy tính của Đại học Tel Aviv tại Israel đã tìm ra cách để vượt qua phần lớn công nghệ nhận diện khuôn mặt mà không cần biết đến mặt nạn nhân.

Trong nghiên cứu mới công bố, họ cho biết sử dụng phương pháp mang tên "master face", áp dụng AI để tạo ra một mẫu khuôn mặt giả nhằm đánh lừa hệ thống nhận diện. Khuôn mặt giả này sau đó có thể sao chép những điểm nhận dạng của nhiều người khác nhằm tạo ra một "khóa vạn năng".

Theo kết quả công bố, nhóm nghiên cứu có thể tạo ra "mặt vạn năng" cho 40% dân số thế giới chỉ với 9 khuôn mặt do hệ thống AI StyleGAN tổng hợp.

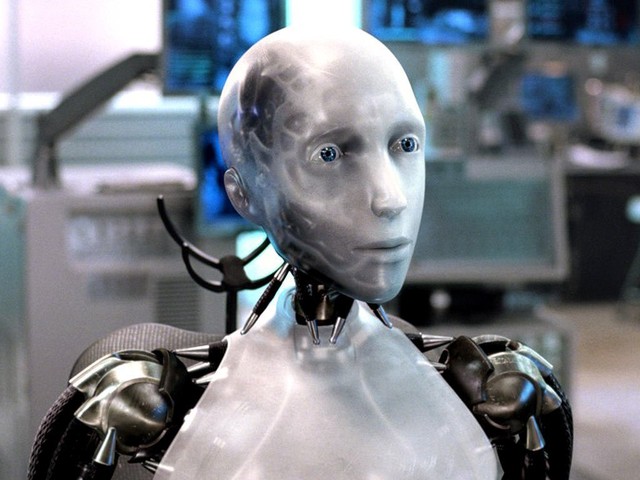

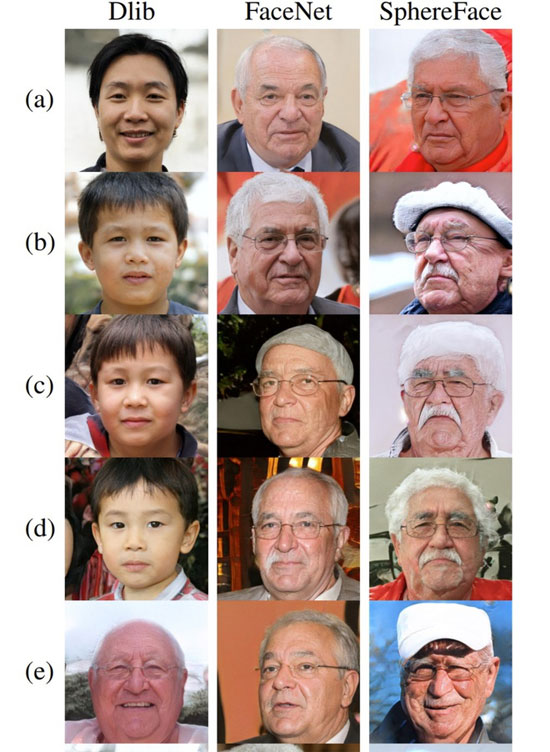

Những ảnh Master Face được tạo bởi StyleGAN cho ra tỷ lệ thành công cao nhất trong các bài thử nghiệm. (Ảnh: Nghiên cứu của Đại học Tel Aviv).

"Kết quả của chúng tôi chỉ ra rằng những phương thức nhận diện khuôn mặt rất dễ bị tấn công, thậm chí ngay cả khi không sở hữu bất kỳ thông tin nào của mục tiêu. Một số phương pháp chống giả mạo được áp dụng nhằm tăng tính bảo mật của bộ nhận diện. Chúng tôi kết hợp một số kỹ thuật khác để có thể vượt qua các biện pháp phòng thủ", các nhà khoa học chia sẻ.

Theo như nghiên cứu, lỗ hổng của đa số hệ thống này là việc chúng sử dụng nhiều bộ dấu hiệu định sẵn để nhận diện danh tính người dùng. Từ đó, nhóm tạo ra một mẫu khuôn mặt tương thích. Thực chất, cuộc tấn công này thành công vì nó tạo ra được nhiều bản sao giống với phần lớn người dùng.

Những mẫu này được tạo bởi thuật toán StyleGAN, một mô hình AI có khả năng tạo ảnh kỹ thuật số về gương mặt của một người không có thật. Chỉ một lần kiểm tra, họ đã thành công mở khóa hơn 20% trong số 13.000 khuôn mặt ở bộ dữ liệu của Đại học Massachusetts. Một số thử nghiệm khác cho ra kết quả cao hơn.

Hơn thế nữa, các nhà nghiên cứu nói rằng sản phẩm của họ có thể kết nối với công nghệ deepfake, có khả năng đánh lừa một số phương thức nhận diện người.

Nghiên cứu cho thấy việc sử dụng nhận diện gương mặt cho các tài khoản mạng xã hội tồn tại nhiều rủi ro. Tin tặc có thể áp dụng phương pháp này để đánh cắp dữ liệu người dùng.

Mặc dù nghiên cứu này chưa được bình duyệt, nó là minh chứng cho nhiều rủi ro tiềm ẩn của công nghệ nhận diện khuôn mặt mà người dùng nên lưu ý. Bên cạnh đó, việc những công cụ này đôi lúc vận hành thiếu liền mạch và một số công ty công nghệ khẳng định rằng sản phẩm của họ vẫn chưa hoàn toàn tối ưu, góp phần khiến quan ngại về độ an toàn của bảo mật bằng gương mặt vẫn còn là một ẩn số.

Công nghệ

-

Câu chuyện kì bí về tên sát nhân hàng loạt đầu tiên trong lịch sử

-

Bộ gene của chúng ta đầy "DNA rác, tại sao không xóa đi?

-

Đào trúng kim cương "15 triệu viên có 1", cặp vợ chồng sướng ngất

-

Quái thú 1 tấn "trên trời rơi xuống", giới khoa học bối rối

-

Khám phá bên trong nhà máy in tiền đầu tiên ở Việt Nam

-

Vì sao sư tử châu Phi dám săn trâu rừng nặng gần 1 tấn nhưng lại không dám săn tê giác?

AI - Trí tuệ nhân tạo

-

Elon Musk cho biết: "AI có xác xuất 20% sẽ hủy diệt loài người"

-

AI Genie - câu trả lời của Google cho Sora: AI tự tạo game 2D với lời nhắc chỉ bằng một hình ảnh duy nhất!

-

AI này có thể tìm kiếm con người qua chiều cao, giới tính bằng qua camera quan sát

-

Giải mã Sora - AI tạo video gây sốt của OpenAI

-

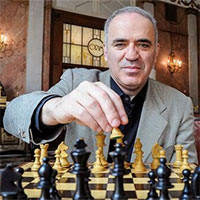

Bất ngờ với một robot tự ý thức được về bản thân

-

Kiện tướng cờ vua Nga mất việc vì AI